Projets:Read For Me

Présentation du projet

Description

Le but est de créer une petite machine à lire portable capable d’acquérir le texte à partir d'une capture d'image et de le lire au moyen d’une synthèse vocale.

Équipe

- François, ArianeGroup, porteur de projet

- Lucie, MHK, coordination

- Leyla, ArianeGroup

- Aldrick, ArianeGroup

- Evan, stagiaire MHK, étudiant Epitech

- Baptiste, IMT

- Célia, designer

- Théo, fabmanager Eesab

- Laurent, Floss Manuals, documentation

Résumé

Le Fabrikarium a permis d'avancer sur de nombreux aspects mais nous n'avons pas eu le temps de recoller les briques ensemble afin de disposer d'un prototype complètement fonctionnel :

- Christophe a fait fonctionné sa machine à lire sur un raspberry pi en ajoutant la prise en charge de la prise de vue et de l'autofocus

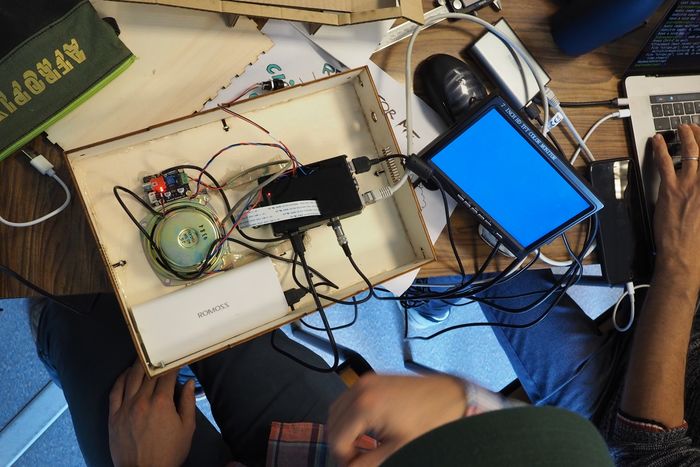

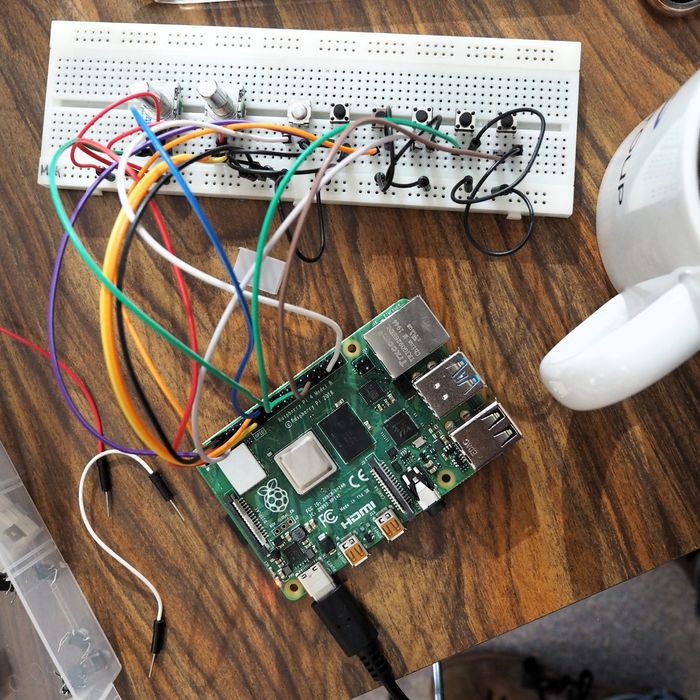

- Aldrick et Evan ont développé toute l'interface logicielle et électronique pour le contrôleur de la machine à lire :gestion des boutons poussoirs et encodeurs rotatifs d'une part et action pour la prise de vue et le déclenchement des raccourcis clavier nécessaire au contrôle de la lecture d'autre part)

- Baptiste a ajouté la lecture en français et perfectionné l'expérience utilisateur d'un prototype existant basé sur PiTextReader (voir plus bas)

- Lucie, Lydia, Théo et Célia ont développé un nouveau prototype matériel en soignant le design de la machine et l'interface du contrôleur adapté pour des personnes mal-voyantes (boutons en relief)

Cette documentation détaille les avancées réalisées sur chacun des points ainsi qu'un tutoriel de réalisation d'un prototype pour lequel il manque néanmoins des étapes (par exemple l'intégration des boutons).

Cahier des charges

Fonctionnalités principales

- Lecture audio sur un haut parleur

- Lecture d'une page A4 multicolonnne en langue française

Fonctionnalités secondaires

- réglage du débit / de la vitesse de lecture

- réglage du volume sonore

- éclairage

- possibilité de mettre en pause

- bouton de mise en marche et de mise à l'arrêt

- prise de vue autofocus

Les contraintes

- Fonctionnement hors ligne : fonctionnement hors ligne ne nécessitant pas de connexion internet

- Portable : fonctionnement sur batterie

- Facile à prendre en main : ne nécessite pas ou très peu de formation

- Rapidité : 10 secondes d'attente maximum

Analyse de l'existant

Des solutions performantes existent déjà pour smartphone, par exemple l'application seeing-ai de Microsoft. Elles ne sont cependant pas satisfaisantes dans tous les cas, en effet :

- Tout le monde ne dispose pas d'un smartphone ou ne souhaite pas en disposer car ils peuvent être difficiles à prendre en main, notamment pour des personnes agées ou déficientes mentales et ce d'autant plus si celles-ci sont mal-voyants.

- Leur usage n'est pas forcément adapté dans le cadre d'école ou de centre d'accueil.

- Les services utilisés ne fonctionne généralement pas hors ligne et cela pose question par rapport au respect de la vie privée et à la divulgation possible d'informations sensibles ou confidentielles sur les serveurs des entreprises qui fournissent ces solutions.

Solutions commerciales

Il semble d'autant plus pertinent de développer une solution "tout en 1" que ce genre de dispositifs est effectivement disponible dans le commerce, à des prix qui peuvent cependant paraître relativement élevés (à partir de 1000€ sur le site www.mieux-voir.fr)

Projets DIY existant

Machine à lire AccessDVLinux

AccessDVLinux est une distribution linux pour déficients visuels développé par Christophe. Dans ce cadre, Christophe a également dévellopé un logiciel de machine à lire : [1].

Ce logiciel fonctionne en mode bureau à l'aide d'un scanner.

Pour répondre à notre cahier des charges, certaines adaptations sont nécessaires :

- Le logiciel doit pouvoir fonctionner à partir d'une caméra à la place du scanner.

- Il doit pouvoir fonctionner sans environnement de bureau, c'est à dire sans écran et sans interaction avec la souris et le clavier.

- Le contrôle de la prise de vue et de la lecture doit se faire à partir de boutons "physiques"

- Il faut pouvoir installer tous les composants logiciels sur un raspberry pi, ce qui n'est pas évident car celui ci n'a sur la même base matériel qu'un ordinateur de bureau ou qu'un ordinateur portable (en particulier son processeur basé sur l'architecture ARM)

Machine à lire sur Raspberry Pi

En amont du Fabrikarium, Lucie et Delphine de MHK ont produit un prototype de machine à lire à partir du projet documenté sur la plateforme Instructables PiTextReader.

Ce prototype (documenté sur ce wiki : Projets:Machine_a_lire_Mémo) est fonctionnel mais la partie synthèse vocale ne fonctionne que pour l'anglais.

Durant le Fabrikarium, une partie de l'équipe va travailler à faire fonctionner la lecture en français et améliorer l'expérience utilisateur de ce prototype.

Solutions logicielles

Au niveau logiciel, en plus de la gestion de l'interface utilisateur, la machine à lire consiste à faire fonctionner successivement deux processus :

- la transformation de l'image en texte, qu'on appelle l'OCRisation,

- la transformation du texte en son : la synthèse vocale.

Pour l'OCRisation, toutes les solutions mentionnées plus haut utilisent le logiciel 'tesseract' disponible sous linux et notamment sur raspbian (pour le raspberry pi).

La question est plus délicate pour la partie synthèse vocale, pour laquelle de nombreuses solutions existent à différents niveaux d'intégration : depuis le lecteur d'écran Orca jusqu'aux briques logicielles plus élémentaires (qu'orca utilise en partie) : speech-dispatcher, espeak, mbrola.

Chacune de ses briques a en effet un rôle particulier pour la réalisation de la synthèse vocale.

Orca gère l'entièreté du processus, mais n'est malheureusement pas simple à contrôler sans un clavier. En tant que lecteur d'écran, il est fait pour être utilisé avec des applications de bureau et non de manière embarqué dans un dispositif sans écran/souris/clavier.

Déroulement du fabrikarium

Prototypage d'une version portable

Le premier jour du fabrikarium, alors que les contraintes techniques par rapport au cahier des charges esperé n'étaient pas encore bien connues, l'équipe de designeur·euse·s s'affaire à prototyper une version portable. Il s'agit de prendre en compte l'encombrement des différents composants (batterie, raspberry pi) dans la conception d'un boîtier, et de réfléchir à l'interface de commande, c'est-à-dire les boutons nécessaires et leur disposition sur le boîtier. Cela se fait d'abord par le dessin puis la réalisation d'un prototype en carton.

/photo de François avec le prototype en main/

Dès le lendemain cependant, on se rend compte qu'il sera compliqué de faire un boitier portable pour l'instant. En effet la mise au point de la caméra et le redressement de l'image ne sont pas encore fonctionnelle sur raspberry pi. La detection du texte ou d'une feuille de papier n'est pas simple non plus et nous ne trouvons aucun projet fonctionnel et documenté à ce sujet.

On repart donc sur une version fixe, à l'image du prototype PiTextReader.

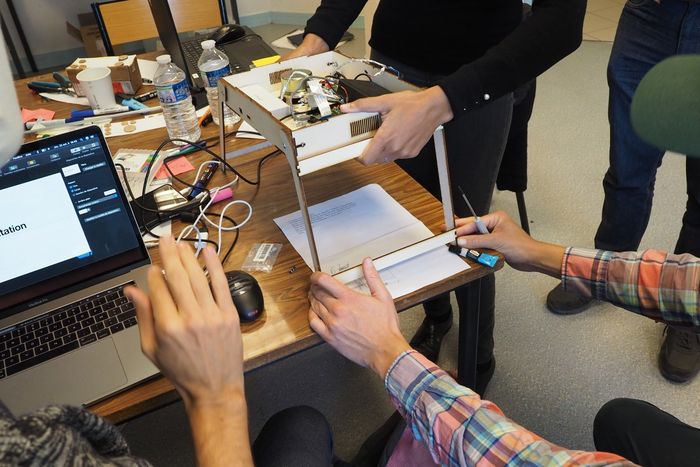

Nouveau prototype de boîtier et d'interface de commande

À partir de ces nouvelles contraintes, les designeur·euse·s décide de partir sur un boitier pliable qui aurait la forme d'un livre et pourrait donc se loger dans une bibliothèque.

L'animation ci dessous montre le principe du pliage/dépliage de l'appareil.

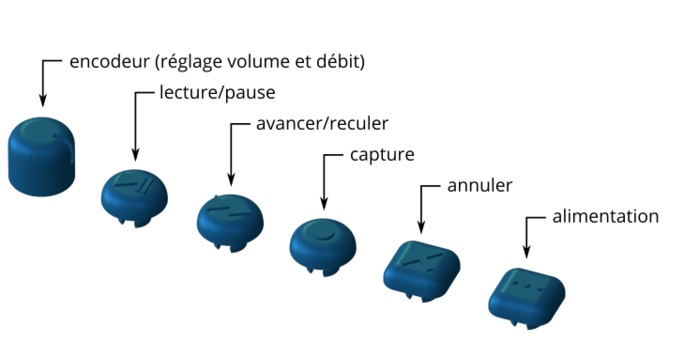

Conception des boutons

Le design joue un rôle important pour les dispositifs utilisé par des personnes mal-voyantes.

Le principe utilisé consiste à utiliser un boutons par fonction, celle ci étant identifiable à partir d'une pictogramme en relier sur chaque bouton.

Développements logiciels à partir de la machine à lire AccessDVLinux

Les développements sont disponibles sur un dépot git hébergé sur le compte github de MHK : ReadForMe

Principe de fonctionnement

Le script principal est le script python Main.py qui permet de faire l'interface entre les commandes connectées au raspberry pi, le script d'aquisition OCRSCan et le lecteur d'écran Orca.

Schéma: Schéma de principe du dispositif

Schéma: Schéma de principe du dispositif

Main.py

Main.py fait appel à plusieurs modules python dont les fonctionnalités sont :

- constantes.py : définition des ports GPIO utilisés pour les boutons et les encodeurs

- buttons.py : définition des actions des boutons poussoirs

- encoder.py : définition de l'objet RotatyEncoder permettant de lire les encodeurs et définition des actions des encodeurs rotatifs

- send_shortcuts.py : émulation des raccourcis clavier (avec xdotool) permettant de contrôler orca

Gestion de l'alimentation

Testé et fonctionnel

Les Raspberry Pi n'ont pas de bouton pour les allumer et les éteindre. Il faut donc le définir nous même à partir des GPIO. La broche GPIO 3 permet de démarrer le raspberry pi quand elle est reliée à la masse.

Le bouton poussoir relié à cette broche a donc deux effets :

- démarrer le raspberry pi lorsqu'il est éteint en utilisant le fait que cette broche est déjà programmé pour réaliser cette action

- éteindre le raspberry pi (c'est à dire arréter proprement le système d'exploitation raspbian) à l'aide d'une action définie en python et exécutée à l'aide du module subprocess

Gestion des boutons

Testé et fonctionnel

La lecture de l'état des boutons et l'exécution des actions qui leur sont liées sont gérées avec la bibliothèque gpiozero. Celle-ci permet en particulier de gérer le processus à l'aide d'événements non bloquants, dont la programmation est détaillée ci-après en prenant l'exemple du bouton d'alimentation.

from gpiozero import Button

from subprocess import run

# définition des actions à effectuer (= événement, dans buttons.py)

def alim_event():

print("alim button pressed")

run(['sudo','shutdown','now'])

# définition des broches utilisées (dans constantes.py)

GPIO_ALIM = 3

# liaison entre le bouton et l'action (dans Main.py)

button_alim = Button(GPIO_ALIM)

button_alim.when_pressed = alim_event

Gestion des encodeurs rotatifs

Testé et fonctionnel

L'objet RotatyEncoder, définit dans encoder.py, permet de la même manière de relier les encodeurs à un événement, qui est également défini sous forme de fonction qui prend cette fois ci un argument qui permet de savoir sur l'encodeur est tourné dans un sens ou dans l'autre.

from encoder import RotaryEncoder

from send_shortcuts import send_shortcut

# événement attaché à l'encodeur (dans encoder.py)

switch_debit = False

def debit_event(val):

global switch_debit

switch_debit = not switch_debit

if switch_debit:

if val<0: # encodeur dans le sens inverse des aiguilles d'une montre

print("débit down")

send_shortcut('KP_Insert+Shift_L+KP_Page_Down')

else: # encodeur dans le sens des aiguilles d'une montre

print("débit up")

send_shortcut('KP_Insert+Shift_L+KP_Page_Up')

# définition des broches utilisées (dans constantes.py)

CLK_DEBIT = 24 #for debit encoder

DT_DEBIT = 25 #for volume encoder

# liaison entre l'encodeur et l'action (dans Main.py)

debit_encoder = RotaryEncoder(DT_DEBIT, CLK_DEBIT, True)

debit_encoder.when_rotated = debit_event

Action des raccourcis clavier sur orca

Non testé

Le seul moyen de contrôler le lecter orca en direct est l'utilisation de raccourci clavier. Ceux ci sont émulés à l'aide de l'utilitaire xdotool. C'est la méthode utilisée pour la version scanner d'OCRSCan.

Si le déclenchement d'action du clavier à partir de python par l'intermédiaire d' xdotool semble fonctionnel, nous n'avons pas pu tester son intégration avec orca lors de la lecture du document.

Execution d'OCRSCan

partiellement fonctionnel

Le bouton capture lance l'exécution lOCRSCan. Il s'agit d'un script de bash qui va exécuter successivement les tâches suivantes (détailler dans les parties suivantes:

- arrêt de orca

- prise de vue et traitement de l'image

- "ocrisation"

- lancement de orca

- ouverture du fichier texte avec mousepad

Prise de vue avec autofocus

Testé et fonctionnel

Avec l'objectif de pouvoir réaliser une version portable, l'utilisation d'une picamera avec un autofocus a été testé. Le script utilisé est issue de la documentation d'Arducam : Motorized_Focus_Camera. Il nécessite d'activer la communication i2c à l'aide du script fourni enable_i2c_vc.sh.

Le script Aquisition_scan.py est un copier/coller du script Autofocus.py de l'exemple cité plus haut ou seul la destination de l'image obtenue est changée.

Détection de la feuille et redressement de l'image

partiellement fonctionnel

Le script scan_main.py sert à détecter une page dans la photo prise à l'étape précedante, puis à corriger la perpective pour remettre la page à plat. En effet, le logiciel d'OCR tesseract admet de léger défauts de perspective mais la tolérance peut être bien plus grande si l'on est capable de redresser la page avec d'autres outils en amont.

Le script utilise du code issue du blog pyimagesearch

Malheureusement, il fonctionne dans des conditions assez précises qui ne permettent pas son utilisation "à mains levés" par une personne mal voyante. Il faut par exemple que les 4 coins de la pages soient bien cadrées, et il est relativement sensible à l'éclairage.

OCRisation avec tesseract

Testé et fonctionnel

Amélioration du projet PiTextReader

En attendant que la solution basée sur le logiciel OCRScan soit fonctionnelle sur raspberry pi, Baptiste a repris le prototype basé sur PiTextReader en y ajoutant le français et une voix française mbrola. Ce prototype ne prend pas en charge l'autofocus et ne permet pas encore de gérer les paramètres de lecture (vitesse, volume, navigation dans le texte).

La version modifiée du code de PiTextReader est disponible sur un dépôt github de MHK.

Toutes les configurations et modifications présentées plus bas sont intégrées sur le dépôts, dans le script d'installation install.sh et dans le scrip python pitextreader.py.

Synthèse vocale en français

La version originale de 'PiTextReader' utilise le logiciel flite comme moteur de synthèse vocale, or celui-ci ne fonctionne pas avec le français.

Pour le français, nous utilisons deux logiciels, spd-say qui est fourni avec le paquet speech-dispatcher, et espeak-ng. Ils sont disponibles dans les dépots raspbian :

sudo apt-get install speech-dispatcher espeak-ng

L'installation de mbrola se fait à partir d'un paquet debian qui n'est pas celui des dépots par défaut du raspberry pi. Pour l'installer :

wget http://steinerdatenbank.de/software/mbrola3.0.1h_armhf.deb sudo dpkg -i mbrola3.0.1h_armhf.deb

Les voix françaises sont bien installable depuis les dépots raspbian :

sudo apt-get install mbrola-fr1

On peut utiliser une des voix française mbrola (par exemple fr4) avec espeak :

espeak-ng -v mb/mb-fr4 "Test d'un texte à lire en français"

Ajout d'un ruban led

Afin d'avoir une luminosité suffisante lors de la prise de photo, des rubans leds RVB addressables ont été ajouté. Pour les contrôler, nous utilisons la librairie python rpi_ws281x. Pour l'installer :

sudo pip install rpi_ws281x

L'utilisation de leds addessables nécessite de lancer le script python en tant qu'utilisateur root. Cela fonctionnait bien sur le raspberry pi 2 utilisé lors du Fabrikarium, mais pas avec le raspberry pi 4 utilisé après coup pour rédiger la documentation. Le ruban led a donc été desactivé dans la version de PiTextReader.

Matériel nécessaire

Electronique

- raspberry pi 4

- carte sd

- arducam caméra pour raspberry pi, 5Mp, autofocus (gotronic)

- batterie de secours ("power bank") USB, 5V

- boutons poussoirs (x6)

- encodeur rotatif (x2)

- bande de leds

- ampli audio DF Robot

- haut parleur

- un morceau de cable USB (alimentation ampli)

Fabrication du boitier

- contreplaqué 5mm

- fil PLA impression 3d

- PMMA diffusant ou transparent

Outils nécessaires

Électronique

- fer à souder

Fabrication

- Découpeuse laser

- Imprimante 3d

Coût

| + Légende du tableau | |||

| Référence | coût unitaire | nombre | coût |

|---|---|---|---|

| Raspberry pi 4 | 60€ | 1 | 60€ |

| Arducam | 18,90€ | 1 | 18,90€ |

https://www.gotronic.fr/art-module-camera-5-mpx-autofocus-b0176-31619.htm

Délai estimé

Fichiers source

Étape de fabrication pas à pas

Installation du raspberry pi

- configuration du raspberry pi

- installation des dépendances logicielles

- démarrage automatique

Schéma de cablage

Cablage de l'audio

Réalisation du boitier

Notes diverses

La piste easyocr

Contrôle d'orca

Pour contrôler le lecteur d'écran orca, on utilise l'émulation d'événement clavier à partir de l'utilitaire xdotool

- KP_Add

- play

- Ctrl

- pause

- KP_Down

- reculer d'un mot

- KP_Up

- avancer d'un mot

- Ins+Maj+KP_PageUp

- augmenter le volume

- Ins+Maj+KP_PageDown

- diminuer le volume

- Ins+Ctrl+KP_PageUp

- augmenter le débit

- Ins+Ctrl+KP_PageDown

- diminuer le débit